python教程

用Python爬虫爬取世界上最大的小电影网站,一天可爬取500万

发布时间:2019-06-11 发布网站:脚本宝典

脚本宝典收集整理的这篇文章主要介绍了用Python爬虫爬取世界上最大的小电影网站,一天可爬取500万,脚本宝典觉得挺不错的,现在分享给大家,也给大家做个参考。

Python + Scrapy + MongoDB,每天爬取500万的数据以上的小电影数据。

免责声明:本项目旨在研究Scrapy Spider Framework和MongoDB数据库,它不能用于商业或其他个人意图。如果使用不当,那将是个人承担。

- 该项目主要用于抓取网站,这是世界上最大的网站。这样做可以检索视频标题,持续时间,mp4链接,封面网址和直接网站的网址。

- 该项目快速抓取PornHub.COM,但结构简单。

- 该项目每天最多可以抓取5万个网站的视频,具体取决于您的个人网络。由于我的带宽慢,我的结果相对较慢。

- 爬虫一次请求10个线程,因此可以达到上述速度。如果您的网络性能更高,您可以每天请求更多线程并抓取更多视频。具体配置请参见[预启动配置]

环境配置

语言:python

python版本:python2.7

电脑配置:MacOS, 4G RAM

数据库: MongoDB

使用说明

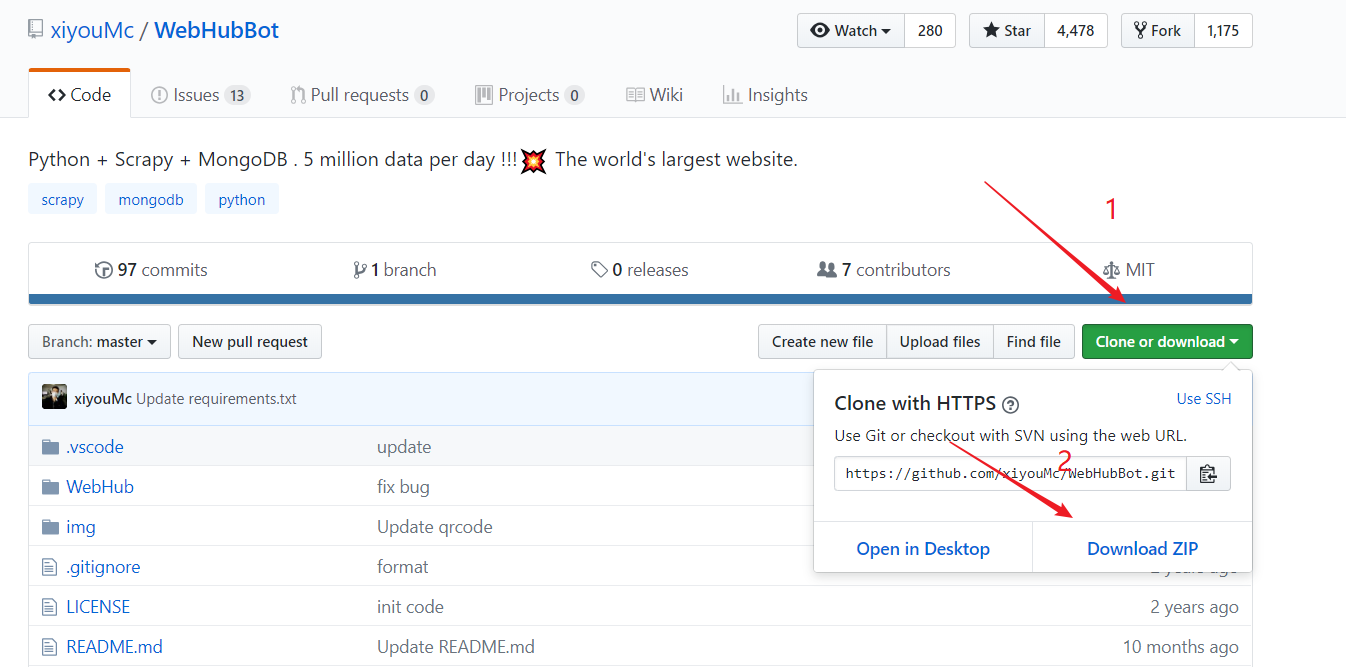

下载源码

方式1

进入:https://github.com/xiyouMc/We...

点击下载源码,下载源码之后解答到一个文件夹

方式2

需要先安装好gIT,安装好之后

git clone https://github.com/xiyouMc/WebHubBot.git

就能将源码下载到本地

预启动配置

如果scrapy使用pip指令安装不上的话。建议使用anaconda进行安装,装好anaconda之后使用conda install scrapy指令会自动解决依赖进行安装

- 安装MongoDB并在没有配置的情况下启动

- 安装Python依赖模块:Scrapy,pymongo,请求或 pip install -r requirements.txt

- 根据需要修改配置,例如间隔时间,线程数等。

启动

- cd WebHub

- python quickstart.py

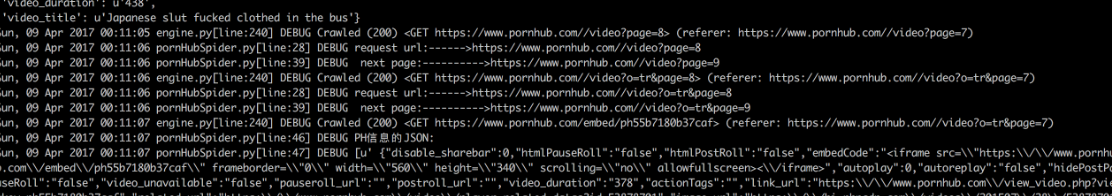

运行屏幕截图

数据库配饰说明

保存数据的数据库中的表是Phres。以下是字段说明:

PhRes表:

video_title: 视频的标题,并且不能重复

link_url: 视频的网址

image_url: 视频的一些截图

video_duration: 视频的时长,单位为秒

quality_480p: 视频的清晰度与下载视频的地址脚本宝典总结

以上是脚本宝典为你收集整理的用Python爬虫爬取世界上最大的小电影网站,一天可爬取500万全部内容,希望文章能够帮你解决用Python爬虫爬取世界上最大的小电影网站,一天可爬取500万所遇到的问题。

本图文内容来源于网友网络收集整理提供,作为学习参考使用,版权属于原作者。

如您有任何意见或建议可联系处理。小编QQ:384754419,请注明来意。

猜你在找的python教程相关文章

- 爆款游戏《贪吃蛇大作战》的 Python 实现 2019-06-09

- Linux 修改Python命令 2019-08-05

- 【python学习--小白篇】python函数中不定长参数的写法 2019-06-30

- 2013年度Python模块 2019-08-05

- 【Python】Python环境的搭建 2019-06-08

- Python线程专题纵览篇 2019-06-21

- python的一些资料和说明 2019-06-25

- Python开发环境搭建 2019-06-24

- 【Python3】Python运算符 2019-06-25

- Python学习资源 2019-06-21

全站导航更多

html5HTML/XhtmlCSSXML/XSLTDreamweaver教程Frontpage教程心得技巧JavaScriptASP.NETPHP编程正则表达式AJAX相关ASP编程JSP编程编程10000问CSS/HTMLFlexvbsDOS/BAThtahtcpythonperl游戏相关VBA远程脚本ColdFusionMsSqlMysqlmariadboracleDB2mssql2008mssql2005SQLitePostgreSQLMongoDB星外虚拟主机华众虚拟主机Linuxwin服务器FTP服务器DNS服务器Tomcatnginxzabbix云和虚拟化bios系统安装系统系统进程Windows系列LINUXRedHat/CentosUbuntu/DebianFedoraSolaris红旗Linux建站经验微信营销网站优化网站策划网络赚钱网络创业站长故事alexa域名photoshop教程摄影教程Fireworks教程CorelDraw教程Illustrator教程Painter教程Freehand教程IndesignSketch笔记本主板内存CPU存储显卡显示器光存储鼠标键盘平板电脑安全教程杀毒防毒安全设置病毒查杀脚本攻防入侵防御工具使用业界动态Exploit漏洞分析

最新python教程教程

- Python每日一练0030

- Py tricks(1): python实现不可修改的常量

- pyenv 安装配置与国内镜像加速 结合 virtualenv

- Win x64 +VS2013 + python2.7环境下caffe的配置学习过程

- python编程分析了一下高考那些事,发现了两个之最,原来是这样

- 为什么要学习Python?这10个理由足够了!

- python3 TypeError: unhashable type set解决方案

- 实战:从Python分析17-18赛季NBA胜率超70%球队数据开始…

- flow.ci + Github + Slack 一步步搭建 Python 自动化持续集成

- VIM自动补全插件:deoplete